Modelli AI e ChatGPT

★★★★★4.7su 280+ recensioni· Scelto da 20M+ businesses

Governa l'uso dell'IA in azienda, proteggi i dati aziendali e aiuta il tuo team a ottenere risultati concreti da ChatGPT.

Download Word gratuitoModificabile onlineEsporta in PDF6+ modelli AI e ChatGPT

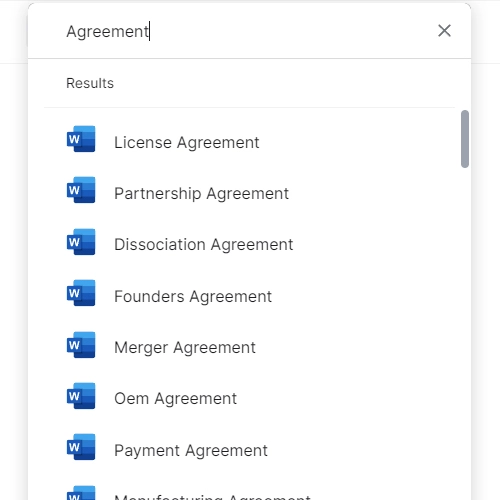

Altre categorie Modelli di Accordi Software e Tecnologia

250K+Clienti

20M+Utenti gratuiti

20+Anni

190+Paesi

10,000+Studi legali

50M+Download

Apprezzato sulle piattaforme di recensioni

- Capterra★★★★☆4.649 recensioni

- G2★★★★☆4.713 recensioni

- GetApp★★★★☆4.649 recensioni

- Google Play★★★★☆4.6179 valutazioni

- Google Reviews★★★★☆4.567 recensioni

Domande frequenti

La mia azienda ha bisogno di una policy AI?

Sì, se uno qualsiasi dei tuoi dipendenti usa strumenti IA al lavoro. Senza una policy scritta, non hai regole applicabili sulla privacy dei dati, sulla proprietà intellettuale o sulla qualità degli output. Una policy di uso accettabile di una pagina è il minimo; le organizzazioni più grandi o normative in genere hanno bisogno di un documento di governance più completo. Il costo di un incidente dovuto a un dipendente che incolla informazioni sensibili in ChatGPT è molto più alto del tempo necessario per scrivere una policy.

Cosa deve coprire una policy di uso accettabile dell'IA?

Come minimo: quali strumenti sono consentiti, quali categorie di dati non possono essere inserite in un prompt IA, un requisito di revisione umana per tutti gli output generati dall'IA, regole sulla proprietà intellettuale e conseguenze per le violazioni. I settori normati dovrebbero anche affrontare come l'uso dell'IA si interseca con gli obblighi di compliance secondo leggi come HIPAA, GDPR o CCPA.

I dipendenti possono usare ChatGPT per il lavoro senza una policy?

Molti dipendenti già lo fanno. La domanda è se quell'uso è sicuro e allineato con gli interessi della tua azienda. Senza una policy, i dipendenti non hanno guida su quali dati possono condividere, quindi le informazioni sensibili spesso finiscono nei prompt involontariamente. Una policy stabilisce confini e protegge sia l'azienda che il dipendente.

Quali dati non dovrebbero mai essere inseriti in ChatGPT?

Dati personali di clienti, fascicoli dei dipendenti, segreti commerciali, codice sorgente, dati finanziari, consulenze legali e qualsiasi informazione soggetta ad accordi di riservatezza non dovrebbero essere inseriti nelle versioni pubbliche di ChatGPT o strumenti simili. I piani API enterprise con accordi di elaborazione dei dati offrono più controllo, ma la stessa cautela si applica senza protezioni contrattuali esplicite.

Con quale frequenza deve essere aggiornata una policy AI?

Almeno ogni sei mesi, dato il ritmo del cambiamento negli strumenti IA e nella normativa emergente. Attiva una revisione fuori ciclo ogni volta che uno strumento importante viene adottato, un sviluppo normativo colpisce il tuo settore o si verifica un incidente significativo.

Una guida a ChatGPT è la stessa di una policy AI?

No. Una guida a ChatGPT è una risorsa educativa — una playbook di prompt, casi d'uso e tecniche per aiutare i dipendenti a lavorare in modo più efficace. Una policy AI è un documento di governance vincolante. Hai bisogno di entrambe: la policy dice ai dipendenti cosa possono e non possono fare; la guida li aiuta a ottenere valore reale da quello che è consentito.

Qual è la differenza tra governance AI e compliance AI?

La governance AI è il framework interno che la tua organizzazione stabilisce per come l'IA viene adottata, usata e supervisionata — policy, ruoli, processi di revisione. La compliance AI si riferisce al rispetto dei requisiti legali e normativi esterni che si applicano all'uso dell'IA, come l'EU AI Act, il GDPR o le regole specifiche del settore. Una buona governance rende più facile dimostrare la compliance.

Modelli AI e ChatGPT vs. documenti correlati

Una policy AI è un documento di governance ampio che definisce l'atteggiamento complessivo dell'organizzazione verso l'IA: principi, tolleranza del rischio, requisiti di protezione dei dati e struttura di accountability. Una policy di uso accettabile dell'IA è più operativa — dice ai dipendenti quali strumenti possono usare, per cosa possono usarli e cosa è vietato. La maggior parte delle organizzazioni ha bisogno di entrambe: la policy stabilisce il framework, il documento di uso accettabile fornisce una guida quotidiana.

Una policy IT Security governa come i sistemi aziendali, le reti e i dati vengono accessati e protetti. Una policy AI si concentra specificamente su come gli strumenti di intelligenza artificiale vengono adottati, usati e supervisionati — inclusi i rischi unici dell'IA come le allucinazioni, i bias, l'esposizione della proprietà intellettuale tramite i prompt e la conservazione dei dati da parte di modelli di terze parti. I due documenti si completano a vicenda e dovrebbero fare riferimento incrociato l'uno all'altro.

Clausole essenziali in ogni Modelli AI e ChatGPT

I documenti di governance IA condividono un set comune di sezioni indipendentemente da quanto dettagliato debba essere l'approccio della tua organizzazione.

- Scopo e ambito. Spiega perché la policy esiste e quali dipendenti, contractor, strumenti e casi d'uso copre.

- Usi consentiti. Elenca i compiti o i workflow specifici dove gli strumenti IA sono approvati — per esempio, drafting, sintesi o revisione del codice.

- Usi vietati. Specifica cosa i dipendenti non possono fare con l'IA, come inserire dati personali, informazioni confidenziali di clienti o codice proprietario.

- Requisiti di protezione dei dati. Definisce quali categorie di dati non devono mai essere inserite in un prompt IA e come gli output generati dall'IA devono essere gestiti.

- Obbligo di revisione umana. Richiede ai dipendenti di verificare i contenuti generati dall'IA prima che vengano pubblicati, inviati o utilizzati.

- Proprietà intellettuale. Chiarisce chi possiede il lavoro assistito dall'IA e quali divulgazioni sono necessarie quando l'IA viene usata in un deliverable.

- Accountability ed enforcement. Specifica chi è responsabile dell'enforcement della policy e quali conseguenze seguono una violazione.

- Cadenza di revisione e aggiornamento. Stabilisce con quale frequenza la policy viene rivista, dato il ritmo veloce dei cambiamenti degli strumenti IA e delle normative.

Come scrivere una policy AI per la tua azienda

Una policy AI pratica richiede meno di un giorno per essere redatta quando sai cosa coprire. Ecco la sequenza che funziona per la maggior parte dei team piccoli e medi.

1

Fai un'audit degli strumenti IA che il tuo team già usa

Prima di scrivere una parola, chiedi ai dipendenti quali applicazioni IA — ChatGPT, Copilot, Gemini, strumenti di scrittura IA — sono già in uso.

2

Definisci la tolleranza del rischio della tua organizzazione

Decidi in anticipo quanto vuoi essere conservatore o permissivo, considerando il tuo settore, la sensibilità dei tuoi dati e eventuali requisiti normativi.

3

Elenca i tool permessi e i casi d'uso approvati

Specifica gli strumenti che i dipendenti possono usare e i compiti per i quali quegli strumenti sono approvati — drafting, ricerca, revisione del codice, traduzione, ecc.

4

Scrivi le regole di uso vietato

Proibisci esplicitamente di inserire dati confidenziali, PII di clienti, segreti commerciali o informazioni normative in qualsiasi strumento IA a meno che non sia in atto un piano enterprise conforme.

5

Affronta la proprietà intellettuale e la divulgazione

Dichiara chi possiede gli output assistiti dall'IA e se i dipendenti devono divulgare l'uso dell'IA a clienti, manager o in materiali pubblicati.

6

Richiedi una revisione umana di tutti gli output IA

Includi un obbligo chiaro di verificare i fatti, controllare i bias e modificare i contenuti generati dall'IA prima che vengano utilizzati in qualsiasi capacità ufficiale.

7

Assegna accountability e stabilisci una schedule di revisione

Nomina un responsabile della policy, stabilisci conseguenze per le violazioni e impegnati a rivedere la policy almeno ogni sei mesi mentre gli strumenti evolvono.

In sintesi

- Che cos'è

- I modelli AI e ChatGPT sono documenti pronti all'uso che aiutano le aziende a stabilire regole per l'uso dell'IA in azienda e a mettere gli strumenti AI a uso pratico. Coprono policy di governance, linee guida per i dipendenti e guide passo dopo passo per applicare l'IA in diverse funzioni aziendali.

- Quando ti serve

- Ogni volta che il tuo team inizia a usare strumenti IA al lavoro — soprattutto ChatGPT — ti serve una policy scritta prima che sorgano problemi e guide pratiche per ottenere valore reale dalla tecnologia.

Quale Modelli AI e ChatGPT mi serve?

Il documento giusto dipende dal fatto che tu debba governare l'uso dell'IA, guidare i dipendenti sulle best practice, o aiutare te stesso o il tuo team a generare reddito con strumenti IA.

La tua situazione

Modello consigliato

Stabilire regole aziendali su come i dipendenti possono usare strumenti IA

Stabilisce confini di governance, regole sui dati e accountability nell'organizzazione.Definire esattamente quali applicazioni IA il personale può usare e come

Elenca gli usi consentiti e vietati in modo che i dipendenti abbiano una guida chiara e pratica.Trovare modi pratici per applicare ChatGPT in diverse funzioni aziendali

Una playbook curata di 80 casi d'uso specifici che copre marketing, operazioni, HR e altro.Integrare l'IA nelle operazioni aziendali quotidiane in modo sistematico

Framework passo dopo passo per identificare, adottare e misurare l'IA nei tuoi workflow.Costruire un reddito secondario o un nuovo business usando strumenti IA

Delinea flussi di reddito provati con IA con step pratici per iniziare.Glossario

- Policy AI

- Un documento organizzativo scritto che stabilisce le regole, i principi e la struttura di accountability per come i dipendenti possono usare strumenti di intelligenza artificiale.

- Policy di uso accettabile

- Un documento più stretto e operativo che dice ai dipendenti specificamente quali strumenti sono consentiti, quali usi sono approvati e cosa è vietato.

- Prompt

- L'istruzione testuale o la domanda che un utente digita in uno strumento IA come ChatGPT per generare una risposta.

- Large language model (LLM)

- Il tipo di sistema IA che alimenta strumenti come ChatGPT — addestrato su grandi quantità di testo per generare risposte in linguaggio umano.

- Allucinazione

- Quando uno strumento IA genera con sicurezza informazioni che sono fattualmente scorrette o completamente inventate, un motivo chiave per cui la revisione umana degli output IA è essenziale.

- Obbligo di revisione umana

- Una regola di policy che richiede ai dipendenti di verificare e modificare i contenuti generati dall'IA prima che vengano pubblicati, inviati a un cliente o utilizzati in qualsiasi capacità ufficiale.

- Data residency

- Dove i dati risiedono fisicamente o legalmente dopo essere stati elaborati — rilevante quando i dipendenti inseriscono informazioni aziendali in strumenti IA ospitati in altre giurisdizioni.

- Governance AI

- La struttura interna di ruoli, policy e processi di revisione che un'organizzazione usa per supervisionare come l'IA viene adottata e usata.

- Shadow AI

- L'uso di strumenti IA da parte dei dipendenti senza consapevolezza o approvazione dell'IT o della gestione — un rischio comune in assenza di una policy IA scritta.

- AI literacy

- La comprensione pratica di un dipendente di come funzionano gli strumenti IA, i loro limiti e come usarli in modo responsabile ed efficace.

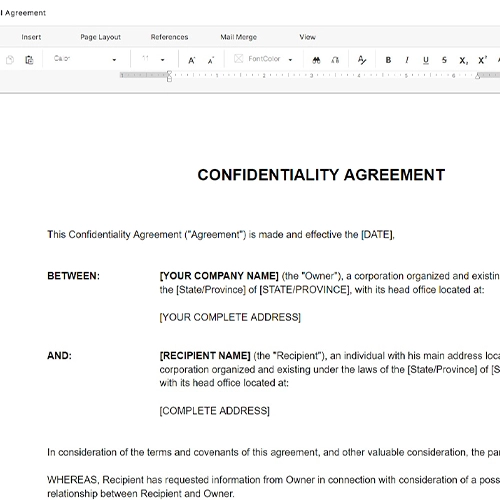

Cos'è un modello AI e ChatGPT?

Un modello AI e ChatGPT è un documento professionale che aiuta le aziende a governare l'uso dell'intelligenza artificiale sul posto di lavoro o a mettere gli strumenti IA in uso pratico e misurabile. Questa categoria copre due tipi di documenti distinti che lavorano insieme: documenti di governance — policy e linee guida sull'uso accettabile che stabiliscono le regole — e guide pratiche che mostrano ai dipendenti e ai proprietari di aziende come applicare gli strumenti IA come ChatGPT nei workflow reali.

I modelli di policy AI danno alle organizzazioni una struttura pronta all'uso per affrontare la protezione dei dati, i casi d'uso consentiti, i requisiti di supervisione umana e l'accountability — senza iniziare da una pagina bianca. Guide pratiche come playbook di ChatGPT e manuali di business IA traducono la tecnologia in compiti specifici: scrittura, ricerca, servizio al cliente, operazioni e generazione di reddito. Insieme, formano la base di un programma IA funzionale per aziende di qualsiasi dimensione.

Quando ti serve un modello AI o ChatGPT

Nel momento in cui il tuo team inizia a usare strumenti IA al lavoro — anche informalmente — ti servono sia una policy che una guida pratica. La maggior parte delle aziende raggiunge questo punto non attraverso una decisione deliberata ma quando notano che i dipendenti stanno già usando ChatGPT per bozze, sintesi o ricerche senza alcuna linea guida.

Trigger comuni:

- Un dipendente incolla una sintesi di un cliente o un riassunto finanziario in ChatGPT e non esiste alcuna regola sui dati

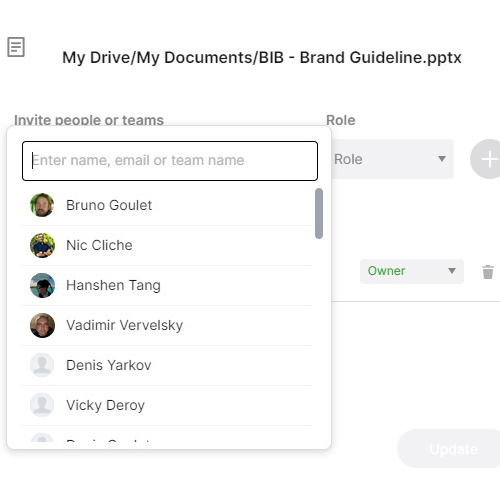

- La leadership vuole adottare strumenti IA ma ha bisogno di un framework di governance prima di distribuire l'accesso

- HR ha bisogno di una policy scritta per far rispettare le conseguenze dell'uso improprio dell'IA

- Un'azienda si sta preparando per un audit di compliance che ora include domande sulla governance AI

- Un fondatore vuole applicare sistematicamente l'IA in marketing, operazioni e servizio clienti

- Un membro del team vuole generare un reddito secondario o lanciare un business usando strumenti IA

- Un manager ha bisogno di una risorsa onboarding pratica per portare lo staff al livello di competenza su ChatGPT

Saltare la governance AI significa che dati confidenziali, informazioni di clienti e contenuti proprietari sono a rischio ogni volta che un dipendente apre una finestra di chat. Una policy chiara e una guida pratica richiedono poche ore per essere implementate e forniscono la struttura di cui il tuo team ha bisogno per usare l'IA in modo fiducioso, sicuro e con effetto reale sul business.

Piattaforma pluripremiata

- Great Place to Work 2025

- BIG Award — Product of the Year 2025

- Smartest Companies 2025

- Global 100 Excellence 2026

- Best of the Best 2025